近年、人工知能(AI)技術は急速に進化し、医療から金融、製造業に至るまで幅広い分野でその利用が拡大しています。

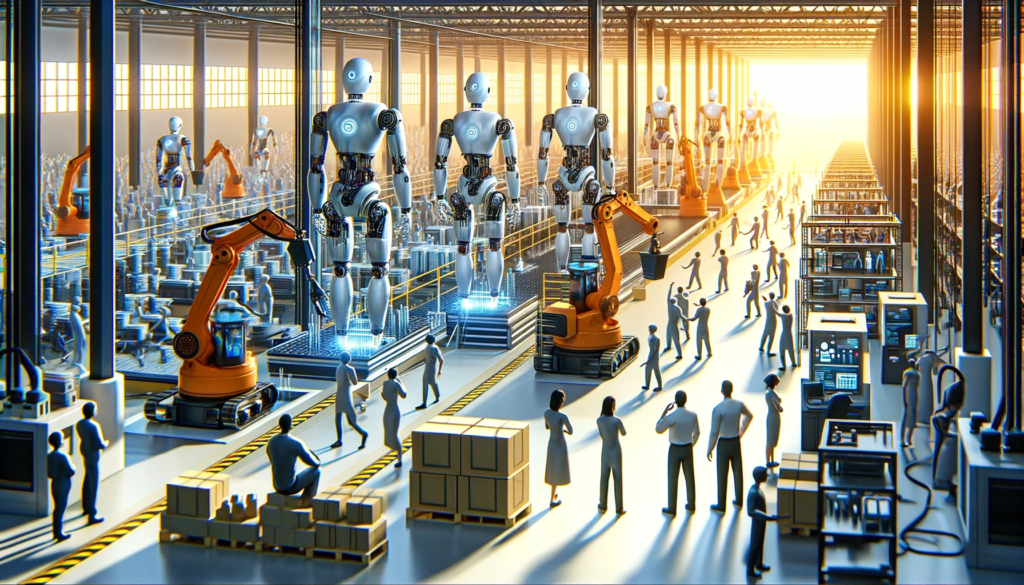

たとえば、医療分野では、AIによる画像診断が病気の早期発見に貢献しており、金融業界では、アルゴリズム取引が市場の効率性を高めています。製造業では、AIを用いた予済保全によって設備の故障を事前に予知し、ダウンタイムの削減と生産性の向上が図られています。

しかしながら、AI技術の急速な発展は、その倫理的な側面にも多くの課題を投げかけています。AIによる決定が人間の判断を超越する可能性、学習データの偏りによって生まれる偏見や差別、さらにはAIの決定に対する責任の所在など、解決すべき問題は山積しています。

これらの問題に対する議論の中で、SF小説は重要な役割を担ってきました。たとえば、アイザック・アシモフの「ロボット」シリーズでは、ロボット工学の三原則が提唱され、AIやロボットが人間社会に及ぼす様々な影響が探究されています。このような作品を通じて、AIの倫理的な指針や、人間とAIの共生のあり方が模索されてきました。

また、フィリップ・K・ディックの「アンドロイドは電気羊の夢を見るか?」では、人工知能を持つアンドロイドと人間との関係が深く掘り下げられ、AIが自我を持つことの倫理的な意味や、人間性の本質について問いかけます。この作品は、AIに対する社会の見方、人間とAIとの境界線について、今日の議論にも大きな影響を与えています。

- AIの自律性と責任の所在について、AIが独自の判断を下すようになった場合、その判断の責任を誰が負うのか、という問題はますます複雑化しています。自動運転車の事故がその一例で、事故が起きた際の責任は開発者、車両、それともAI自体にあるのか、という問いが提起されています。

- AIによる偏見と差別の問題は、AIが人間の学習データから偏見を学習してしまうことに起因します。例えば、採用プロセスにAIを用いる際、訓練データに含まれる性別や民族に対する偏見が、採用の決定に無意識のうちに反映されてしまう恐れがあります。このような問題に対処するためには、AI開発者は偏見を含まないデータセットの作成、AIアルゴリズムの透明性の確保といった取り組みが求められます。

- AIと人間の共存に関する課題では、AIが人間の能力を超えた場合の社会的影響が議論されます。人間とAIの役割分担、相互の協力関係の構築など、共存のための具体的な方策が模索されています。

まとめると、AI技術の進展は私たちに多大な恩恵をもたらしますが、同時に多くの倫理的課題を引き起こしています。S

F小説を通じて提起される未来のビジョンや倫理的問題は、私たちがこれらの課題にどのように向き合い、解決していくべきかについて、貴重な洞察を与えてくれます。これらの物語から学び、現実世界での倫理的なAI開発に向けた議論を深め、実践的な指針を形成していくことが、これからの社会にとって不可欠です。